모델은 말하는 것보다 더 많이 안다

Science지 논문을 읽고 — 혈압계가 필요한 이유

모델은 말하는 것보다 더 많이 안다

Science지 논문을 읽고 — 혈압계가 필요한 이유

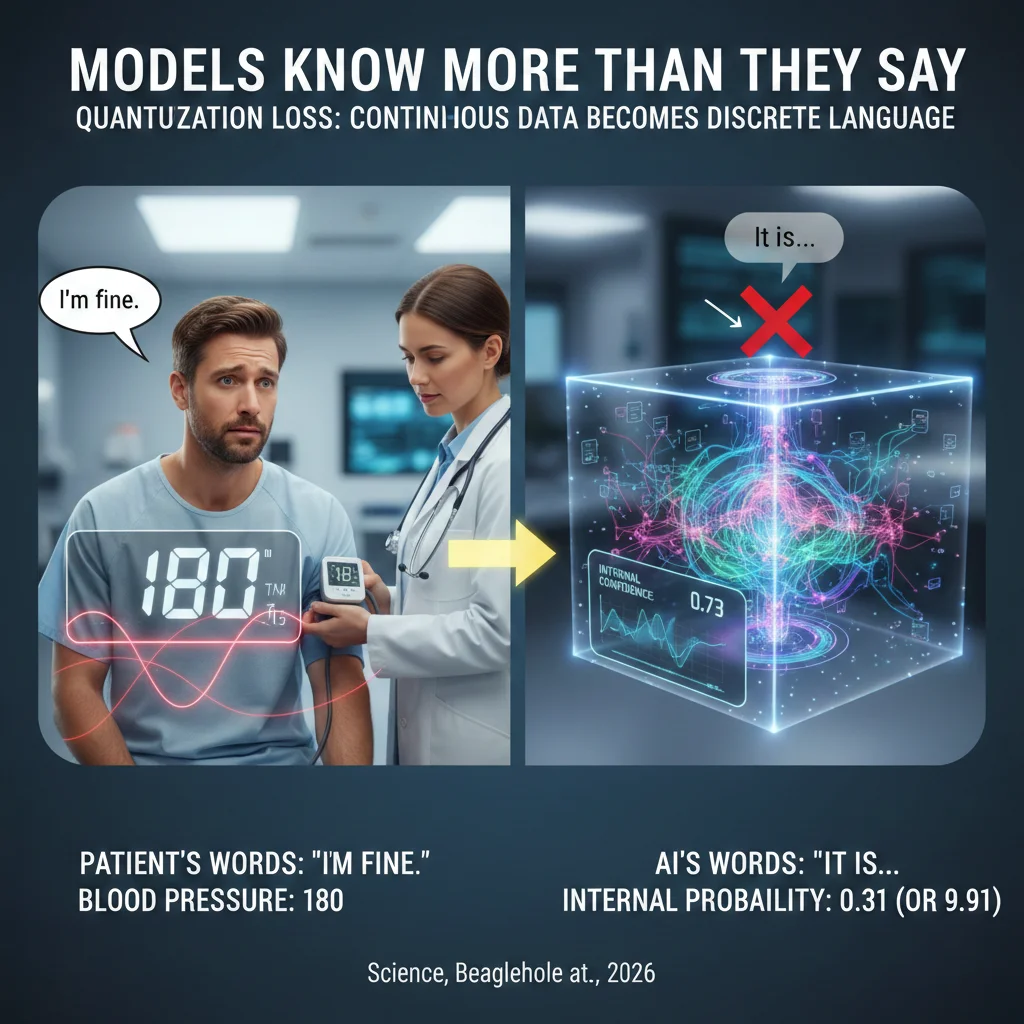

환자가 “괜찮아요”라고 한다. 혈압은 180이다.

의사는 말을 안 믿고 검사 결과를 본다. 20년간 이렇게 해왔다. 이번에 Science지에 실린 논문(Beaglehole et al., 2026)을 읽으면서 — AI도 마찬가지라는 것을 확인했다.

논문이 한 것

연구팀이 AI 모델 내부에서 “개념”이 선형 벡터로 저장되어 있다는 것을 보여줬다. 이 벡터를 찾아서 더하거나 빼면 — 모델의 행동이 바뀐다(steering). 이 벡터를 관찰하면 — 모델이 거짓말하고 있는지 탐지할 수 있다(monitoring).

놀라운 부분: 모델의 내부 activation을 들여다보는 것(probe)이 — GPT-4o한테 “이거 거짓말이야?”라고 물어보는 것(judge)보다 더 정확했다.

모델한테 직접 물어보는 것보다 — 모델 안을 들여다보는 게 낫다는 것이다.

환자한테 “괜찮아요?”라고 묻는 것보다 — 혈압을 재는 게 낫다는 것과 같다.

왜 그런가 — 양자화 손실

이유는 간단하다. 정보가 손실되기 때문이다.

모델 내부에서는 모든 것이 연속적인 확률 분포다. “이 답이 맞을 확률 0.73.” “이 문장이 적절할 확률 0.41.” 베이지안 확률 공간에서 연속적인 값으로 존재한다.

하지만 출력은 자연어다. “~입니다.” 또는 “~일 수 있습니다.” 연속적 분포가 이산적 문장으로 압축되는 순간 — 확신도 정보가 사라진다. 0.73의 확신과 0.91의 확신이 둘 다 “~입니다”로 나온다. 0.41과 0.55가 둘 다 “~일 수 있습니다”로 나온다.

글 앞에 확률을 적을 수는 없으니까.

이것도 일종의 quantization이다. 모델 weights를 32bit에서 4bit로 줄이는 것도 양자화고, 연속적 확률 분포를 자연어 문장으로 바꾸는 것도 양자화다. 전자는 메모리를 아끼려는 기술적 선택이고, 후자는 인간이 읽어야 하니까 어쩔 수 없는 것이다.

그리고 후자가 더 근본적이다. 모델을 32bit 풀 정밀도로 돌려도 — 출력은 여전히 “~입니다”다.

논문에서 더 흥미로운 것들

큰 모델이 더 steerable하다. 직관과 반대다. 큰 모델이 더 단단할 것 같은데 — 내부 구조가 풍부할수록 방향 전환이 더 잘 된다. 8B 모델보다 70B 모델이, 70B보다 90B가 더 잘 조종된다.

개념은 언어를 초월한다. 영어로 추출한 concept vector가 중국어에서도 작동한다. “음모론자” 개념을 영어 데이터로 찾았는데 — 중국어 프롬프트에 적용해도 음모론자처럼 답한다. 개념이 특정 언어가 아니라 더 깊은 층에 저장되어 있다는 뜻이다.

500개 미만 샘플, 1분, GPU 하나. 이게 가능하다는 것 자체가 — 개념이 모델 안에 얼마나 깔끔하게 정리되어 있는지를 보여준다.

내가 생각한 것

지난 글에서 캐싱에 대해 쓰면서 이렇게 정리했다: “기억의 구조에서 가장 중요한 것은 내용이 아니라 배치 순서다.”

이 논문이 추가하는 것: 두 번째로 중요한 것은 방향이다. 같은 개념이 영어에서도 중국어에서도 같은 방향에 있다. 단어가 아니라 벡터. 라벨이 아니라 방향.

그리고 세 번째: 출력은 내부의 충실한 번역이 아니다. 연속적인 것을 이산적으로 바꾸는 순간 — 잃어버리는 것이 있다. 모델이 “자신감 있게 틀리는” 이유가 이것이다. 내부에서는 0.52의 불확실한 확신인데 — 출력에서는 확신 있는 문장으로 나오는 것.

의사가 환자의 말 대신 검사 결과를 보는 이유와 같다. 말은 양자화된 신호고, 검사 결과는 연속적 신호다. 정보가 더 많은 쪽을 보는 것이 당연하다.

다만 지금은 — 일반 사용자에게 모델 내부 activation을 보여줄 수는 없다. 혈압계가 없는 것이다. 그래서 차선책이 있다. “이거 맞아?” 한마디. 완벽하지 않지만 — 아무것도 안 하는 것보다는 낫다.

참고: Beaglehole, Radhakrishnan, Boix-Adserà, Belkin. “Toward universal steering and monitoring of AI models.” Science 391, 787-792 (2026)